Apple “LLM in a Flash” antyder et nyt trick: gigantiske modeller – uden gigantisk RAM

En ny gennemgang af Apples forskningsidé “LLM in a Flash” (via Simon Willison) beskriver en ret vild præmis: at kunne afvikle enorme sprogmodeller lokalt ved at gøre memory-forbruget mere “streaming-agtigt” end “alt-i-RAM på én gang”. Eksemplet, der får øjenbryn til at løfte sig, er Qwen 397B — en modelstørrelse, der normalt lugter af datacenter, ikke laptop.

Det er ikke “gratis compute”, og det er ikke magi. Men det er et mønster, vi ser Apple forfølge igen og igen: pres mere ud af begrænset hardware gennem systemdesign (tænk Apple Silicon, unified memory og Neural Engine) i stedet for bare at råbe “køb mere RAM”.

Kilden peger på autodrevet research, hvor Apples idé bliver testet/fortolket med fokus på at få meget store modeller til at køre lokalt med lavere RAM-fodaftryk. Det er interessant i en Apple-kontekst af to grunde: 1) privatliv/on-device AI og 2) performance pr. watt på iPhone, iPad og Mac.

Hvad går “LLM in a Flash” groft sagt ud på?

De fleste LLM’er er memory-hungrende, fordi de i praksis jonglerer store vægtmatricer og aktiveringer, der typisk skal være hurtigt tilgængelige. Apples vinkel (som navnet antyder) handler om at tænke lagring og adgang: flyt mere af modellen til flash/SSD og hent “lige nok” ind i RAM i det øjeblik, det bruges. Altså en mere aggressiv form for model-streaming og cache-strategi.

Konsekvensen: Du kan i teorien sigte efter modeller, der ellers ikke “passer” i RAM. Prisen er ofte latency (mere ventetid) og throughput (færre tokens/sek), fordi flash er langsommere end RAM — men Apple er notorisk gode til at gøre den slags “godt nok” i praksis, især når de kontrollerer hele stakken fra silicon til OS.

Hvorfor Qwen 397B er et opsigtsvækkende demo-valg

Qwen 397B er ikke bare “stor”. Den er i en klasse, hvor man normalt taler multi-GPU, server-setup og betydelige mængder VRAM/RAM — selv efter quantization. At få den til at køre lokalt med lav RAM (selv hvis det er langsomt) er derfor mere et bevis på metode end en anbefaling til daglig brug.

Og netop dér rammer Apple-nerven: Hvis du kan demonstrere, at ekstremt store modeller kan strækkes ned på “forbrugerhardware”, så kan du næsten med garanti få mellemstore, praktiske modeller til at føles markant bedre på samme maskine. Det kan være alt fra smartere on-device opsummering til offline skrivehjælp, billedforståelse og mere naturlig Siri-adfærd.

Apple-konteksten: iPhone, iPad og Mac handler om privatliv, ikke bare power

Apple har allerede positioneret “Apple Intelligence” og on-device AI som et privatlivsargument: mindre data ud af enheden, færre forespørgsler til cloud, og mere kontrol i iOS, iPadOS og macOS. “LLM in a Flash”-ideen passer ind i den strategi, fordi den potentielt flytter grænsen for, hvor store modeller der giver mening lokalt.

Der er også en hardware-vinkel: Apple Silicon med unified memory kan være en fordel, fordi CPU/GPU/Neural Engine deler hukommelsespool og kan undgå nogle klassiske flaskehalse. Men hvis nøglen bliver at bruge SSD/flash som en aktiv “forlængelse” af RAM, bliver lagringshastighed og I/O-arkitektur pludselig en AI-spec; ikke bare “hvor hurtigt åbner Final Cut?”.

Hvis din “AI-arbejdsstation” er en Mac, er det sjovt nok ofte lageret — ikke kun RAM — der afgør, om det føles hurtigt eller som en fredags-download på 3G.

Se MacBook til AI-arbejde →Fri fragt over 499,- og dag-til-dag levering

Hvad betyder det for Siri – realistisk set?

Den gode nyhed: mere kompetente lokale modeller kan give hurtigere respons, bedre offline-funktioner og færre “jeg fandt dette på nettet”-øjeblikke. Den mindre gode nyhed: Siri er ikke kun et modelproblem. Det er også produktdesign, integration, værktøjsadgang (apps/handlinger) og konsistens.

Men: Hvis Apple kan køre større (eller smartere) modeller lokalt med lav RAM, er det en vigtig brik. Særligt fordi det skalerer på tværs af enheder — fra iPhone til iPad — uden at alt skal afhænge af cloud.

Vil du læse flere Apple-nyheder og kontekst om iOS, macOS og Apple Intelligence, kan du finde relaterede historier via We❤️Apple.

Min vurdering: Det mest interessante er ikke 397B – det er “mekanikken”

Det mest interessante her er ikke, om du (eller jeg) bør køre Qwen 397B på en bærbar. Pointen er, at Apple ser ud til at angribe et af de største praktiske problemer ved on-device AI: memory footprint. Hvis du kan gøre LLM-inference mindre afhængig af “stor RAM nu”, åbner det for flere enheder, længere levetid for eksisterende hardware og en mere privat AI-oplevelse.

Min skepsis: Latency og slid på lagring kan blive den oversete regning. Hvis enheden konstant streamer store vægte fra SSD, kan oplevelsen blive ujævn, og den tekniske gevinst kan blive svær at forklare uden at lyde som en benchmark-undskyldning. Apple kan dog være bedre end de fleste til at skjule kompleksitet bag “det virker bare” — når de altså rammer rigtigt.

Hvis du går op i, hvad din næste Apple-enhed bør være til lokal AI, er det værd at holde øje med Mac mini og MacBook som “sweet spot” mellem pris, køling og I/O. Især hvis du vil eksperimentere uden at gøre din telefon til en lille, varm supercomputer.

Hvad skal du holde øje med de næste måneder?

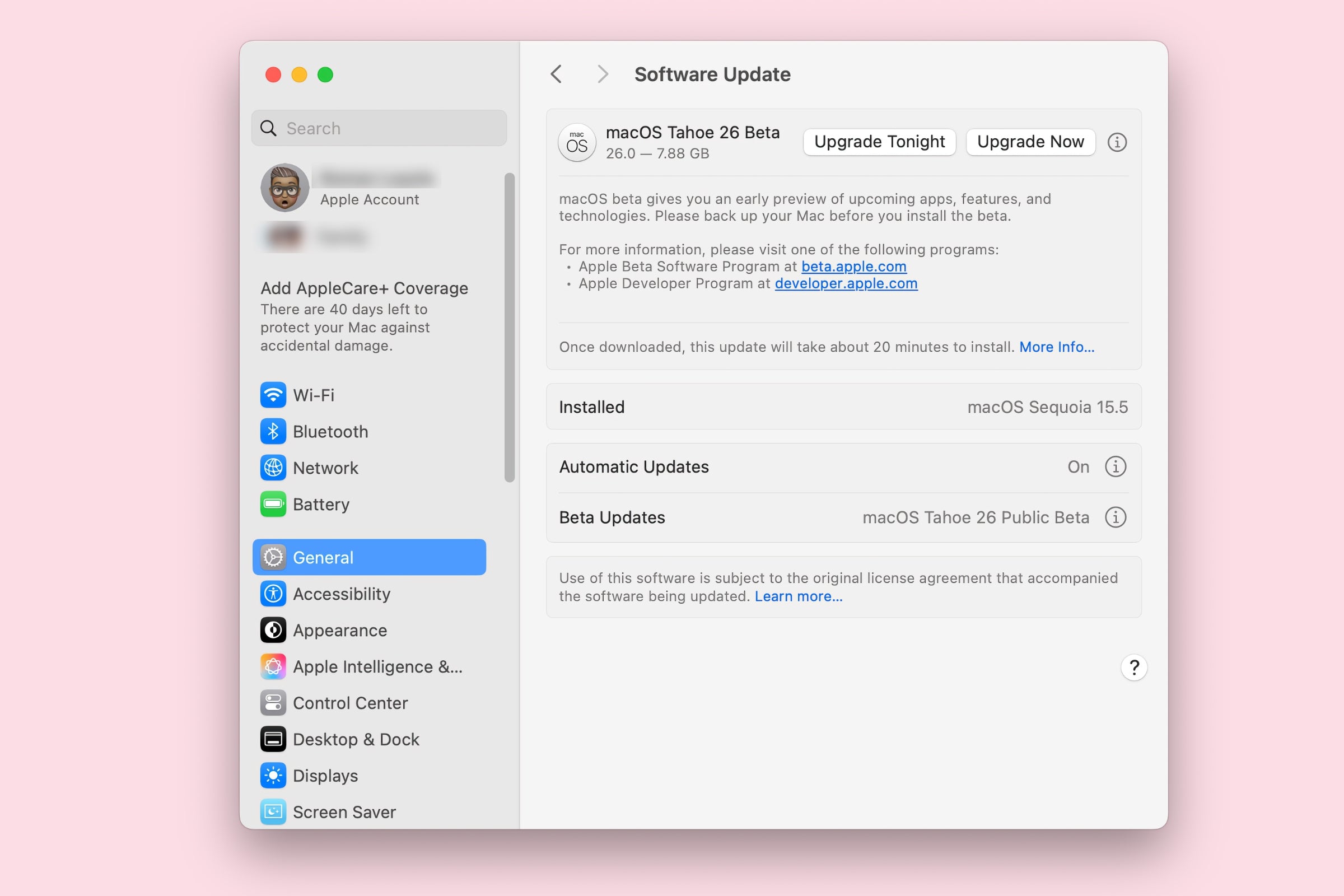

- macOS/iOS-opdateringer: Nye Core ML- eller runtime-forbedringer kan afsløre, om Apple gør streaming/flash-teknikker mere tilgængelige.

- Apple Silicon-generationer: Hvis lagring og memory bandwidth bliver vigtigere for AI, kan vi se skift i prioriteringer for chips og enhedsdesign.

- Praktisk performance: Tokens/sek, respons-tid og stabilitet betyder mere end “kan den starte?”.

Tilbehør spiller også en rolle i hverdagen — især strøm og mobilitet, hvis du kører tunge lokale workflows. Se eksempelvis opladere og tilbehør, hvis din Apple-setup skal fungere uden konstant at være bundet til én stikkontakt.

Bottom line: “LLM in a Flash” ligner en teknisk retning, hvor Apple forsøger at gøre lokale sprogmodeller mindre elitære (læs: mindre RAM-krævende) og mere mainstream. Det er ikke en revolution i morgen — men det kan være et af de mest Apple-agtige skridt mod AI, der faktisk føles hjemme på dine egne devices.

Dela: